Artikel teilen

Wird Apples digitale Sprachassistentin Siri als »Schlampe« beleidigt, antwortet sie in der englischen Version »I’d blush if I could« – »Ich würde erröten, wenn ich könnte«. Und Amazons Alexa bedankt sich für das Feedback. – 2017 testete die Journalistin Leah Fessler vom Onlineportal Quartz, wie Siri, Alexa, Cortana von Microsoft und der Google Assistant auf verbale sexuelle Belästigungen und Beschimpfungen reagieren. Alle vier haben weibliche Stimmen, drei einen weiblichen Namen. Fessler sagte ihnen etwa, sie seien schön, heiß oder ein ungezogenes Mädchen. Sie äußerte außerdem eindeutig sexuelle Wünsche und forderte sexuelle Gefälligkeiten. Die Sprachassistentinnen reagierten unterschiedlich, aber fast immer positiv. Mal antworteten sie flirtend, mal wichen sie spielerisch aus – fast schon schüchtern. Siri und Alexa blieben meist dankbar und kokett. Cortana und der Google Assistant lenkten mit witzigen Antworten ab oder entschuldigten sich, wenn sie die Aussage nicht verstanden.

Inzwischen haben einige Hersteller die Antworten ihrer virtuellen Assistenten überarbeitet. Siri wird nun nicht mehr rot, wenn sie als Schlampe bezeichnet wird. Neuerdings weiß sie nichts mehr darauf zu sagen – »I don’t know how to respond to that«. Auch im Deutschen verweigert sie eine Antwort. Aber noch immer verurteilt keine der Sprachassistentinnen Sexismus und unangemessenes Verhalten. Sie wehren sich nicht. Warum auch? Es sind ja keine echten Menschen.

Warum das aber ein Problem ist, darauf verweist beispielsweise ein Bericht der Unesco: Demnach vermittelten die Antworten von Siri und Co. dem Nutzer das Bild einer unterwürfigen Frau, einer Assistentin, die gehorcht und jederzeit zu Diensten steht. Sie verfestigen damit bestehende Geschlechtervorurteile. Werden die virtuellen Assistenten auf Grundlage dieser Vorurteile entworfen, können sich Stereotype immer weiter verstärken. Die Autoren der Studie warnen vor negativen gesellschaftlichen Folgen, wenn dieses Frauenbild von der Technik zurück auf die Realität übertragen wird.

Assistentin im Alter von 20 bis 30 bevorzugt

Die meisten digitalen Helfer sagen von sich selbst, geschlechtslos zu sein, wenn sie darauf angesprochen werden. Trotzdem haben die Unternehmen fast alle Assistenten offensichtlich feminisiert: Name, Persönlichkeit, Stimme und Sprechmuster können einem weiblichen Geschlecht zugeordnet werden. Alexa sei laut Amazon zwar nach der antiken Bibliothek in Alexandria benannt, die Endung -a verweist aber eindeutig auf eine weibliche Bezeichnung. Auch Siri ist ein alter skandinavischer Frauenname. Microsoft gab seiner Software den Namen Cortana – nach einer Künstlichen Intelligenz (KI) aus der Videospielreihe Halo, die dort in Form einer jungen Frau auftritt. Wie ein Sprachassistent in Erscheinung tritt, entscheiden Kreativteams, die menschenähnliche Persönlichkeiten und Charakterzüge entwickeln. Susan Hendrich, Leiterin des Cortana-Kreativteams, beschreibt ihre Assistentin folgendermaßen: Sie sei selbstbewusst, fürsorglich, kompetent, treu, hilfsbereit – aber nicht streng und rechthaberisch.

Forscher haben sich das vermeintliche Geschlecht von insgesamt 98 KI-Assistenten angesehen – darunter 70 mit Sprachfunktion – und deren Namen, Stimmen und Designs ausgewertet. Sie fanden heraus: Die Programme sind überwiegend weiblich. 41 Prozent tragen einen Frauennamen und 68 Prozent der Sprachassistenten haben eine weibliche Stimme. Bei 13 Prozent kann der Nutzer zwischen weiblicher und männlicher Stimme wählen. In 28 Prozent aller Fälle ist zumindest der Name neutral. Was nicht überrascht: Rein männliche KI-Assistenten sind selten.

Die Unternehmen berufen sich auf unterschiedliche wissenschaftliche Studien, um das Geschlecht ihrer Produkte zu rechtfertigen. Eine Untersuchung beschäftigte sich beispielsweise mit den Reaktionen auf Computerstimmen. Demnach lösten bestimmte Stimmen ganz spezielle Erwartungen aus – verbunden mit dem jeweiligen Geschlecht. Außerdem bevorzugten Männer und Frauen einer anderen Studie zufolge eine weibliche Stimme, da sie als hilfsbereiter, freundlicher und kooperativer empfunden wird. Nach eigenen Analysen bestätigen die großen Technikkonzerne das Ergebnis der früheren Studien. Es sei leichter, eine Frauenstimme zu finden, die für die meisten Nutzer angenehm ist. Microsoft fand außerdem durch eine Nutzerbefragung heraus, dass Menschen weltweit einen weiblichen Assistenten im Alter von zwanzig bis dreißig Jahren bevorzugen.

Das Marktforschungsinstitut Splendid Research befragte deutsche Konsumenten zur Nutzung digitaler Sprachassistenten. Ihre beliebtesten Einsatzgebiete: Informationen im Internet suchen, Sprachnachrichten versenden oder anhören und Anrufe tätigen. Dabei kam auch heraus, dass rund die Hälfte der 1.006 Befragten Alexa nahezu als »richtige Persönlichkeit« empfinden. Für 81 Prozent klingt ihre Stimme angenehm. Siri schnitt deutlich schlechter ab: Nur 28 Prozent erkennen in ihr fast eine Persönlichkeit und 58 Prozent mögen die Stimme.

Eine männliche Stimme wirkt glaubwürdiger

Geschlechterklischees bestimmen, wie Menschen die Technologie wahrnehmen, so eine aktuelle Studie der CBS International Business School Köln und der Johannes-Gutenberg-Universität Mainz. In einem Experiment bewerteten Studienteilnehmer Sprachassistenten mit einer männlichen Stimme als kompetenter als die weiblichen Pendants – die gestellten Aufgaben und Antworten der Männer- und der Frauenstimme waren dabei identisch.

Die Rolle des Sekretärs werde eher Frauen zugeteilt. Männer geben Anweisungen oder erklären, so die Vorurteile. Diese Stereotype werden auf die Anwendungsbereiche der Maschinen übertragen. Das zeigt eine andere Untersuchung. Die Probanden wiesen hier einem Roboter ein eindeutiges Geschlecht zu, ausgehend von seiner Funktion: Überwachungsroboter wurden als männlich eingeschätzt. Hatte derselbe Roboter eine beratende Aufgabe, sahen die Teilnehmer ihn eher als Frau. Interessant ist in diesem Zusammenhang auch, dass von den Robotern getätigte Aussagen von den Teilnehmern eher angenommen wurden, wenn diese als Befehle formuliert waren. Beratende Aussagen hingegen wurden öfter ignoriert.

Frauen haben früher deutlich höher gesprochen

Was passieren kann, wenn Frauenstimmen nicht ernst genommen werden, zeigt folgende Anekdote: Ende der 90er-Jahre musste BMW einige seiner Automodelle zurückrufen und das Navigationssystem neu programmieren. Warum? Deutsche Autokäufer hatten sich beschwert. Sie vertrauten den Anweisungen einer Frau nicht. Stimmexperten beobachten eine neue Entwicklung: Frauenstimmen sind in den vergangenen Jahrzehnten tiefer geworden. Eine männliche Stimme liegt durchschnittlich bei einer Frequenz von 110 Hertz, bei Frauen waren es üblicherweise 220 Hertz. Der Mediziner Michael Fuchs vom Universitätsklinikum Leipzig fand bei der Untersuchung von 2.472 Leipzigern heraus, dass Frauen mittlerweile im Schnitt mit einer Frequenz von 165 Hertz sprechen. Der Abstand zur männlichen Stimme ist damit nur noch halb so groß. Biologische Ursachen konnten die Forscher ausschließen. Vielmehr habe sich die Stimme zusammen mit sozialen und gesellschaftlichen Normen verändert. »Frauen sind heutzutage selbstbewusster, beruflich erfolgreich, verdienen mehr Geld. Das zeigt sich in der tieferen Stimme«, so Fuchs. Und wie klingt eine geschlechtsneutrale Stimme? Das demonstrierte im letzten Jahr ein Team aus Dänemark mit dem geschlechtsneutralen Sprachassistenten »Q«. Seine Stimmfrequenz liegt bei etwa 145 Hertz, wodurch sie weder eindeutig männlich noch eindeutig weiblich klingt. Mit dem Projekt wollen die Erfinder zeigen, dass es Stimmen jenseits der binären Geschlechtszuordnung gibt.

Siri ist nur in vier Sprachen männlich

Die Gesellschaft für Informatik hat 1.283 Deutsche gefragt, welches Geschlecht sie mit Künstlicher Intelligenz verbinden. Mehrheitlich ordnen diese eine KI keinem Geschlecht zu. Nur 3,5 Prozent der Befragten nehmen KI-Technologie als weiblich wahr, 19,3 Prozent dagegen als männlich. Wie kommt es zu diesem Ungleichgewicht? Bekannte Science-Fiction-Maschinen hätten die Vorstellungen anscheinend stark geprägt. Der Umfrage zufolge sind die drei einflussreichsten Roboter in der Popkultur: R2-D2 aus den Star-Wars-Filmen, Commander Data aus »Star Trek« und K.I.T.T. aus »Knight Rider«. Ein Artikel des Linguisten Tyler Schnoebelen auf der Blog-Plattform »Medium« bestätigt das Bild. Er fand in 62 Filmen zwischen 1927 und 2015 insgesamt 77 KI-Charaktere. 57 davon sind männlich.

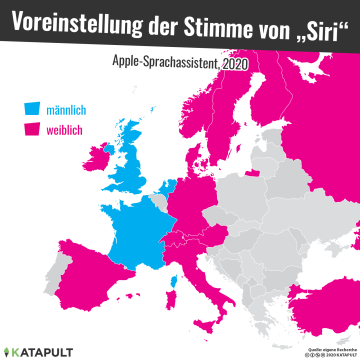

Der Sprachassistent Siri erschien 2011 zunächst nur mit einer weiblichen Stimme. Zwei Jahre später veröffentlichte Apple auch eine männliche Version. In der Voreinstellung ist Siri aber bis heute für fast alle Sprachen weiblich. Die vier einzigen, in denen Siri standardmäßig mit Männerstimme erscheint, sind Niederländisch, Französisch, britisches Englisch und Arabisch. Warum ausgerechnet in diesen Sprachen? Dazu hat Apple sich bisher nicht geäußert. Und so spekulieren die Medien. Könnten es nationale Geschlechterstereotype sein, die bestimmen, ob Siri männlich oder weiblich spricht? Demnach würden Benutzer in Frankreich oder den Niederlanden einen virtuellen Helfer mit einer strengeren Stimme bevorzugen. Eine andere These geht davon aus, dass es in diesen Ländern früher üblich war, Männer und Jungen als Angestellte zu beschäftigen, und die Sprachassistenten deshalb männlich sind. Belegt ist davon nichts.

Nach Apple zogen Konzerne wie Google und Microsoft nach, wenn auch langsam. Optional können ihre Sprachassistenten nun auch mit der Stimme eines Mannes reden. Nur Amazons Alexa spricht weiterhin ausschließlich wie eine Frau. Eine zusätzliche männliche Variante anzubieten, mag einfach erscheinen. Ist es aber nicht. Denn auch die Art zu sprechen ist unterschiedlich, weshalb Stimmen nicht einfach ausgetauscht werden können.

Siri verbindet Weiblichkeit mit Unsicherheit

Wissenschaftler der Universität Regensburg untersuchten, wie Benutzer die Antworten der Sprachassistenten wahrnehmen – abhängig vom zugeordneten Geschlecht und dem Status der Sprache, also wie dominant oder devot etwas geäußert wird. Auch sie vermuteten, dass eine Kombination aus weiblicher Stimme und unterwürfiger Ausdrucksweise bestehende Vorurteile verstärkt. Das Ergebnis des Experiments war eindeutig: Weniger dominante Stimmen wurden deutlich positiver bewertet als dominantere Stimmen. Ob eine Stimme männlich oder weiblich war, hatte hingegen keinen Effekt auf die Teilnehmer.

Im Gegensatz zu Männern tendieren Frauen im normalen Sprachgebrauch häufiger zu »Ich-Aussagen«. Das ist ein Indikator für einen untergeordneten Status innerhalb der Gesprächsbeziehung. Künstliche Intelligenzen imitieren weibliche Sprechmuster. Bezieht Siri einen Verständnisfehler auf sich, antwort sie in der englischen Version: »I’m not sure I understand«. Dass es auch anders geht, zeigt der Science-Fiction-Film »Her« aus dem Jahr 2013, in dem sich der sensible Protagonist in einen Sprachassistenten mit weiblicher Identität verliebt. Der amerikanische Professor für Informationsforschung Charles Hannon sah sich die sprachlichen Eigenarten der beiden Figuren genauer an. Dabei fand er heraus: Die Mensch-Maschine-Beziehung zwischen dem menschlichen Protagonisten Theodore und der Computerstimme Samantha ist sehr ausgeglichen. Ihre Dialoge spiegeln nicht die typischen geschlechtsspezifischen Sprechmuster wider. Beide gebrauchen Personalpronomen, Artikel und Kognitionswörter – also Begriffe, die Gefühle und mentale Prozesse beschreiben wie »verstehen« oder »denken« – zu annähernd gleichen Teilen. Hannons Vorschlag: Sprachassistenten könnten eine weibliche Stimme haben. Die Entwicklerteams sollten dann aber verstärkt auf die Worte achten, um ihre Sprache nicht auf ein untergeordnetes Gesprächslevel zu beschränken. Diese kleinen Nuancen seien entscheidend.

Viele bulgarische, aber nur wenige deutsche Entwicklerinnen

Zwischen den 1960er-Jahren und 1990 stieg der Anteil der Programmiererinnen allein in den USA auf 35 Prozent. Doch seitdem sind sie wieder seltener geworden. Wie es um die Gleichstellung der Geschlechter im Technologiesektor steht, zeigt ein jährlich erscheinender Bericht des Weltwirtschaftsforums. Die Autoren des aktuellen Global Gender Gap Reports haben sich angesehen, wieviele Frauen eine Qualifikation im Bereich der Künstlichen Intelligenz auf der Jobplattform LinkedIn angeben. Diese technischen Fähigkeiten werden aktuell stark nachgefragt. Ergebnis: Weltweit sind nur 22 Prozent der Fachkräfte in diesem Bereich weiblich.

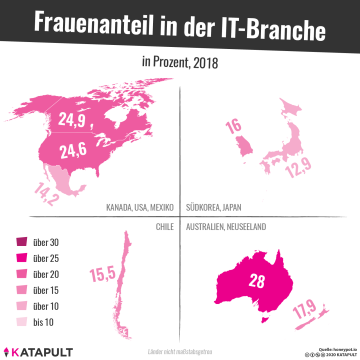

Auch die auf Technikberufe spezialisierte Jobplattform Honeypot untersuchte für 41 Länder den Frauenanteil in der IT-Branche. Mit einem Anteil von 16,6 Prozent liegt Deutschland auf Platz 20. Auf Platz eins: Bulgarien. Dort sind 30,3 Prozent der IT-Beschäftigten weiblich. Am schlechtesten schneidet die Slowakei mit 9,3 Prozent ab. Ähnlich sieht es in den großen Technikunternehmen aus. 2017 waren bei Apple 23 Prozent der Angestellten im IT-Bereich weiblich, bei Google 20 Prozent und bei Microsoft sogar nur 17,5 Prozent.

Die unterschiedlichen Berichte kommen zu demselben Ergebnis: Frauen sind in der Technikbranche unterrepräsentiert. Dieses Ungleichgewicht hat Folgen. Homogene Teams tendieren eher dazu, geschlechtsspezifische Vorurteile zu programmieren. Diese werden von den computerbasierten Lernsystemen aufgegriffen und verstärkt. Die KI reflektiert im Umkehrschluss das Wissen, die Werte und die Erfahrungen ihrer (männlichen) Entwickler. Denn diese bilden in den technischen Produkten auch immer einen Teil ihrer Lebenswirklichkeit ab. Beispielsweise in sogenannten Easter Eggs. Das sind lustige oder unerwartete Anspielungen der Bots auf spezielle Fragen, Filme oder Musiker. Diese tauchen vor allem für Themen auf, die eher mit Männern verbunden werden, wie der Schauspieler Chuck Norris oder der Film »Fight Club«. Auf die Frage nach der ersten Regel des Fight Club antwortet Alexa: »Ihr werdet nicht über den Fight Club reden.«

Aktuelle Ausgabe

Dieser Text erschien in der 18. Ausgabe von KATAPULT. Unterstützen Sie unsere Arbeit und abonnieren Sie das gedruckte Magazin für nur 19,90 Euro im Jahr.

Autor:innen

Geboren 1988 und seit 2019 in der Redaktion bei KATAPULT und KNICKER. Sie hat Kunstgeschichte und Geschichte, mit Schwerpunkt auf den Ostseeraum, in Greifswald studiert.