Filteralgorithmen im Internet

Gleichschaltung durch die Filterblase

Von Tim Ehlers und Jürgen Geuter

Artikel teilen

2011 prägte der Amerikaner Eli Pariser den Begriff der »Filterblase«. Können Sie kurz beschreiben, was Pariser damit gemeint hat?

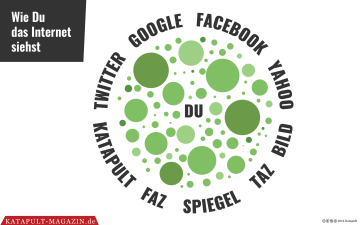

Unter der Filterblase versteht Pariser, dass sich Menschen im Internet und auf den Plattformen, auf denen sie sich bewegen, wie Facebook, oder auch bezüglich der Medien, die sie konsumieren, eine Art Blase um sich herum aufbauen. Darin fühlen sie sich wohl, weil sie in der Blase nur noch Meinungen zulassen und wahrnehmen, die der eigenen entsprechen.

Das kann damit zu tun haben, dass man beispielsweise auf Facebook nur mit Menschen befreundet ist, die die gleiche Meinung haben wie man selbst. Das kann ebenfalls damit zu tun haben, dass man nur Medien konsumiert, die die gleiche Meinung vertreten wie man selbst. Bezogen auf Facebook bedeutet das, dass ein Benutzer oder eine Benutzerin immer bestimmte Inhalte »liked« und der Algorithmus deshalb entscheidet, dieser Person mehr Inhalte dieser Art zu zeigen. Das kann dazu führen, dass man nur noch Dinge sieht, die der eigenen Meinung entsprechen, und den Rest der Welt ausklammert. Die Wahrnehmung der Welt, die nur noch auf das Ich bezogen ist und auf das, was mir gefällt, nennt Pariser die Filterblase.

Die Informationen werden also gefiltert. Welche Internetformate nutzen Filter?

Heute ist es fast schwieriger, Internetplattformen zu finden, die nicht auf irgendeine Weise solche Filter verwenden. Zu den ganz großen zählt natürlich Facebook, wo der Newsfeed ganz stark auf die eigenen Interessen und auf die eigenen Aktivitäten zugeschnitten wird und auf das, was man »liked«. Auch Videoplattformen wie Youtube nutzen Filter, um einem mehr Videos vorzuschlagen, die offensichtlich ungefähr so funktionieren, wie das, was man schon mochte. Ganz beliebt und als Feature wahrgenommene Filter gibt es bei Musik-Streamingdiensten wie Spotify. Sie nutzen Filter als Werbeargument: »Wir haben für Dich Musik zusammengestellt, die Dir garantiert gefallen wird.«

Bei Twitter hingegen werden alle Informationen in der zeitlichen Reihenfolge angeordnet. Allerdings schlägt Twitter auf Basis der gefolgten Accounts dem Benutzer oder der Benutzerin immer wieder Leute vor, die für ihn oder sie interessant sein könnten. Damit wird auch das, was Pariser eine Filterblase nennen würde, weiter angeschoben. Denn es wird versucht, einen mit mehr Menschen zu umgeben, die dem eigenen Umfeld auf der Plattform ähnlich sind.

Es geht also immer in die Richtung der Interessen, die ein Mensch sowieso schon vorher hat?

Das Konzept von Pariser geht davon aus. Was wir heute sehen, ist, dass es aber durchaus auch anders funktioniert: Die Algorithmen zielen nicht unbedingt nur auf das, was mir gefällt. Es soll vor allem Interaktion erzeugt werden – und dafür funktioniert Kontroverse manchmal genauso gut. Jemanden ganz bewusst auf Dinge zu stoßen, die ihn oder sie wütend machen, sorgt dafür, dass diese Inhalte kritisiert, kommentiert und geteilt werden. Ein Anbieter generiert so mehr Aufmerksamkeit, mehr Traffic auf der eigenen Plattform.

Solch eine Vorschlagsalgorithmik muss also nicht immer die Filterblase bedienen, sondern kann sogar das Gegenteil erzeugen. Denn die Ziele einer Medienplattform sind ja nicht, eine Filterblase bereitzustellen, sondern Interaktion zu fördern. Da kollidieren zwei Interessen.

Ist bekannt, wie Filter auf Facebook, Twitter oder Google funktionieren?

Keine Plattform legt ihre Filteralgorithmen offen. Es gibt gewisse Filtermechanismen, die man sich langsam erschließen kann, oder man bekommt ein gewisses Gespür dafür, wie sie funktionieren könnten. So hat es bei Facebooks Newsfeed beispielsweise etwas mit Likes und Klicks zu tun, aber konkret weiß man das nicht. Zudem verändert beispielsweise Facebook auch ständig seinen Algorithmus. Daher verhält sich »mein« Facebook morgen vielleicht anders, als es das heute tut.

Aber die Geheimhaltung hat auch ganz pragmatische Gründe: Denn sobald Betreiber von Internetseiten wissen, wie ein Filteralgorithmus funktioniert, werden diese versuchen, ihre Inhalte so umzugestalten, dass sie von den Filteralgorithmen der Plattformen besonders häufig angezeigt werden. Deshalb sagt Google beispielsweise nicht genau, wie sein Suchalgorithmus funktioniert, damit die Qualität der Suchergebnisse hoch und die Ergebnisse selbst frei von Spam bleiben. Wenn jeder weiß, welche Kriterien oder Schlüsselworte dafür sorgen, dass man möglichst weit oben bei den Suchanfragen gelistet wird, würden alle Anbieter diese Worte verwenden. Und plötzlich funktionieren die Kriterien nicht mehr. Es gibt also durchaus auch ein berechtigtes Interesse der Plattformen, ihre Filteralgorithmen nicht zu 100 Prozent offenzulegen.

Wie können Benutzer diese Filter umgehen?

Umgehen ist sehr schwierig bis unmöglich. Es gibt für die jeweiligen Plattformen kleine Tricks. Auf Facebook kann man zum Beispiel alle Kontakte einer Gruppe zuordnen. Dadurch entsteht ein Newsfeed, bei dem alle Beiträge ungefiltert und chronologisch angezeigt werden. Das könnte Facebook zukünftig allerdings auch wieder verändern.

Ein Benutzer kann einen Dienst auch anonym, also nicht eingeloggt nutzen. Das funktioniert allerdings auch nicht besonders gut, da die Dienstanbieter auch noch andere Tricks haben, um herauszubekommen, wer man denn eigentlich ist.

Das Geschäftsmodell dieser Dienste ist, dass sie möglichst viel Interaktion erzeugen. Das bedeutet, dass sich Nutzer auf der Plattform bewegen, denn dadurch schauen sie sich Werbung an oder kaufen irgendetwas. Facebook, Youtube oder Spotify haben also immer ein Interesse daran, genau zu wissen, wer da gerade herumklickt. Ein Nutzer oder eine Nutzerin kann auf Facebook ein anonymes Profil anlegen. Aber sobald er anfängt, sich in ähnlichen Bereichen zu bewegen wie bei seinem anderen Profil, wird der Nutzer von Facebook schnell auch wieder in denselben Kasten sortiert.

Das große Missverständnis bei einigen Menschen ist, dass sie glauben, es sei alles zu 100 Prozent individualisiert. Es geht aber nicht darum, eine Person individuell zu beschreiben, sondern eine Person einem Kasten zuzuordnen, um ihm oder ihr dann entsprechende Inhalte zu zeigen

Das große Missverständnis bei einigen Menschen ist, dass sie glauben, es sei alles zu 100 Prozent individualisiert. Das stimmt häufig nur eingeschränkt. Facebook bildet stattdessen so etwas wie Kästen. Es gibt alle Menschen auf der Welt und es gibt bestimmte Interessen. So sortiert Facebook die Menschen in die jeweiligen Kästen ein. Eine Person kann auch in mehreren Kästen sein. Es geht aber nicht darum, eine Person individuell zu beschreiben, sondern eine Person einem Kasten zuzuordnen, um ihm oder ihr dann entsprechende Inhalte zu zeigen.

Sobald sich jemand auf einer Plattform bewegt, hinterlässt er oder sie Spuren. Das lässt sich nicht vermeiden, denn ich klicke etwas an und folge von dort einem Link auf einen weiteren Inhalt. So werden Verbindungen erzeugt. Und über diese Verbindungen vermittle ich der Plattform, wie ich denke und wie mein Interesse funktioniert. Genauso wird man selbst anonym sehr schnell wieder einem Kasten zugeordnet, der schon existiert.

Nur so ist die Charakterisierung von Menschen für eine Plattform möglich. Sie halten die Anzahl der Kästen überschaubar, ansonsten ist es irgendwann so individualisiert, dass es auch für die Betreibenden (oder deren Kunden, wie beispielsweise die Werbeindustrie) keinen Sinn mehr ergibt. Deshalb wird auch versucht, die Menschen ein wenig zu normen.

Das ist meiner Meinung nach das größere Problem als das, was Pariser als Filterblase bezeichnet. Ich finde es problematischer, dass über diese Form von Vorschlägen und die Steuerung von Informationsflüssen Menschen deutlich mehr in genormte Richtungen gezwungen werden. Wenn ein Betreiber eine begrenzte Anzahl von Typen analysiert, wird er irgendwie darauf hinwirken, dass sich alle Leute auch wie diese Typen verhalten, da der Einzelne ansonsten schwer zu bewerten ist. Komplexe Interessencluster werden auf einfache heruntergebrochen, sodass von Plattformen gemachte Vorschläge manchmal auch sehr unangemessen sind.

Wie werden diese Kästen konstruiert?

Stichwort »Big Data«: Früher war es so, dass man, um ein Problem zu verstehen, ein mentales Modell davon gebaut hat. Dann wurde geschaut, ob das Modell funktioniert und wenn ja, hat man damit seine Fragen beantwortet.

A squirrel dying in front of your house may be more relevant to your interests right now than people dying in Africa

Heute, in den Zeiten von Big Data, besitzt man eine Menge von Daten, die zeigen, wie sich Menschen verhalten. Und jetzt werden einfach Korrelationen herausgesucht, Dinge, die zusammen auftreten, ohne ein konzeptionelles Modell zu erstellen. Youtube beispielsweise ist es egal, welche Videos ich schaue und welche Inhalte Videos haben. Youtube schaut nur, was zusammen auftritt: Leuten, denen dieses Video gefallen hat, hat auch jenes Video gefallen. Manchen Leuten hat ein bestimmtes Video gefallen, anderen nicht – diese gehören offensichtlich nicht in denselben Cluster, also Kasten. Aber diese Cluster haben keinen Namen oder bestimmte Themen – es sind Korrelationen. Und das macht diese Kategorisierung auch so schwierig. Ein Benutzer wird in einen Cluster eingeordnet und es wird gar nicht ersichtlich, warum. Es ist auch nicht ersichtlich, was diese Kategorie ausmacht. Diese Cluster kann ich mit keiner Bedeutung füllen. In einem Cluster können auch Dinge zusammenfallen, die für eine bestimmte Person gar nicht zusammenfallen dürfen, weil diese Zusammenhänge in der Masse möglicherweise bestehen, aber nicht für einen bestimmten Benutzer. An dieser Stelle ist der Benutzer ausgeliefert und kann nicht bestimmen, was ihm eigentlich angezeigt werden soll.

Könnte der Begriff der Filterblase auch auf die Welt außerhalb des Internets angewendet werden?

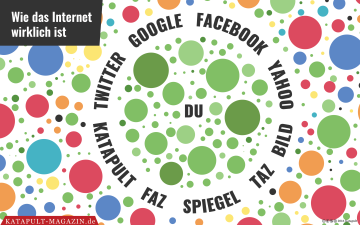

Der Begriff wurde zwar für den Bereich des Internets geprägt. Aber vor dem Bewusstsein, dass das Internet nur ein Bereich der realen Welt ist, existiert die Filterblase auch in der analogen Welt. Leute, die sich Tageszeitungen abonnieren, haben auch nicht alle abonniert. Und damit befinden sie sich schon in einer Filterblase. Die Welt in ihrer Komplexität ist auch gar nicht erfassbar, wenn wir nicht anfangen, zu filtern. Es ist wichtig, dass wir jungen Menschen beibringen, wie man eigentlich die Welt um sich herum gestaltet. Dass man auch Dinge zulassen kann und wie man mit Kontroversen umgeht.

Bezogen auf die Plattformen, müssen wir als Benutzer verlangen, dass sie transparenter über die Art und Weise, wie sie uns einschätzen, sind. Uns muss die Möglichkeit gegeben sein, auch explizit einzugreifen.

Den deutschen Medien wird derzeit von vielen Seiten vorgeworfen, dass sie einseitig berichten – praktisch einen ganz bestimmten Filter benutzen. Sehen Sie in der Gatekeeper-Funktion der Medien Parallelen zu Internetfiltern?

Ja, es gibt strukturelle Parallelen, aber ich würde das nicht gleichsetzen. Facebooks Filter beispielsweise hat einen ganz bestimmten Bias, also ein Vorurteil, der besagt: Interaktion, etwas liken, teilen, anklicken, ist immer gut.

Alle klassischen Medien, die wir kennen – Zeitungen, Fernsehen, Radio –, haben natürlich auch gewisse Ausrichtungen. Diese stehen meist nicht explizit vorn drauf, aber natürlich weiß man mittlerweile, welche Zeitung sich eher links oder eher rechts verortet. Wenn man das weiß, kann man damit auch umgehen und Artikel dementsprechend einordnen. So etwas lernt man teilweise auch in der Schule.

Mit der zunehmenden Digitalisierung zerfällt die Einordnung stärker. Früher nahm ein Leser oder eine Leserin eine bestimmte Zeitung in die Hand und konnte diese anhand des Titels schnell einordnen. Heute wird alles in demselben Browser oder Newsfeed angezeigt. Mit einem Klick gelangt der Benutzer oder die Benutzerin möglicherweise von einer progressiven zu einer konservativen Zeitung, ohne geistig einen besonderen Bruch gemacht zu haben. Auch durch das ähnliche Design der verschiedenen Zeitungen ist auf den ersten Blick manchmal der Unterschied nicht sofort sichtbar. Das macht es schwieriger, die Ausrichtung zu erkennen. An dieser Stelle nähern sich die klassischen Medien ein wenig den Internetfiltern an. Dadurch, dass nur einzelne Artikel und nicht die ganze Zeitung angeboten und konsumiert werden, zerfällt die einordnende Struktur.

Was ist das Positive an Filteralgorithmen im Netz?

Ich glaube, dass jeder Mensch das Recht hat, zu entscheiden, mit wem oder was er oder sie sich umgeben möchte. Das ist auch ein zivilisatorischer Fortschritt: Jemand hat ganz bestimmte Interessen und kann sich mit diesen beschäftigen. Und dadurch, dass sich jeder mit ganz bestimmten Dingen beschäftigt, ist vielleicht jeder auch ein Experte für irgendetwas. In der Demokratie werden dann alle Interessen zusammengeführt – das nennt man dann Politik – und man trifft gemeinsame Entscheidungen.

Ich halte deshalb den Aufbau einer eigenen Filterblase, die auch bestimmte Sachen nicht an eine Person heranlässt, für ganz wichtig, um überhaupt ein menschenwürdiges Leben zu führen. Es kann nicht die Aufgabe von Internetplattformen sein, Menschen mit Inhalten zu konfrontieren, die sie aus diversen Gründen nicht in ihrem Leben zulassen können oder wollen.

Wenn Plattformen die Strukturen ihrer Filter den Betroffenen gegenüber klarer kommunizieren würden und Menschen mehr direkte Steuerungsmöglichkeiten gäben, wären Filteralgorithmen sogar ein sehr wertvolles Werkzeug für die Verwirklichung des Schutzes der Menschenwürde.

Das Interview führte Tim Ehlers

Aktuelle Ausgabe

Sie wollen auf Online-Filter verzichten? Abonnieren Sie KATAPULT und lesen weitere spannende Beiträge in unserer gedruckten Ausgabe.

Autor:innen

Geboren 1983, ist seit 2015 Redakteur bei KATAPULT und vor allem als Layouter, Grafiker und Lektor tätig. Er hat Germanistik, Kunstgeschichte und Deutsch als Fremdsprache an der Universität Greifswald studiert.

Sein wissenschaftliches Hauptinteresse liegt im Bereich der Sprachwissenschaft.

Jürgen Geuter (alias tante), Jahrgang 1979, hat an der Universität Oldenburg Informatik und Philosophie studiert. Er ist als unabhängiger Wissenschaftler tätig und beschäftigt sich vor allem mit dem Digitalen als Lebensrealität, der Ethik des Digitalen und Algorithmenregulierung.